从H0.5到H0.7:BeingBeyond如何用人类视频数据撬动具身智能范式革命

2019年,当大多数具身智能团队还在围绕机器人本体采集数据时,卢宗青提出了一个让不少人觉得另类的观点:让机器人学人类行为。

这个判断在当时显得有些超前。行业的主流逻辑很清晰——用遥操作获取真机数据,在单一本体上反复打磨,先让机器人能动起来。

但卢宗青看到的不是“能动的机器人”,而是“通用能力从哪来”。机器人的终点是人类世界,那么训练数据的最优分布,未必在机器人本体上,更可能在人类行为本身。

这是BeingBeyond人类视频路线的起点,也是后来H0.5诞生的认知基础。

H0.5:验证一个关键假设

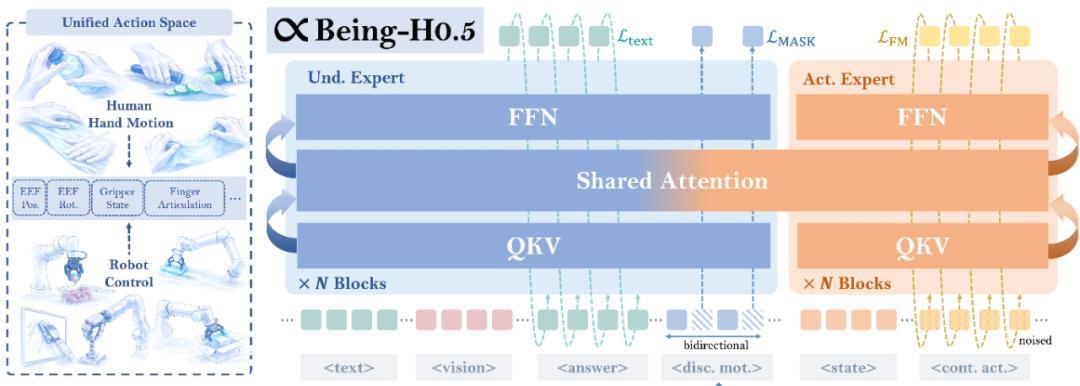

2024年,Being-H0.5发布。这不是一款普通的产品,而是一个假设的实证。

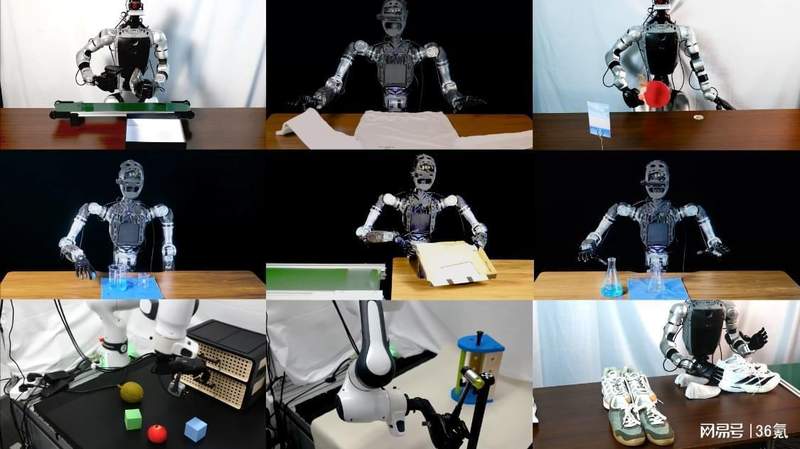

假设的核心是:如果用足够规模的人类行为数据与多本体数据共同训练,模型能否在不同机器人之间迁移,并在复杂任务中保持稳定表现?

答案是肯定的。H0.5证明了human-centriclearning在技术层面可行。通用模型第一次在跨本体维度上接近专用模型的能力边界。

H0.7:强化真实场景能力

紧接着,H0.7登场。

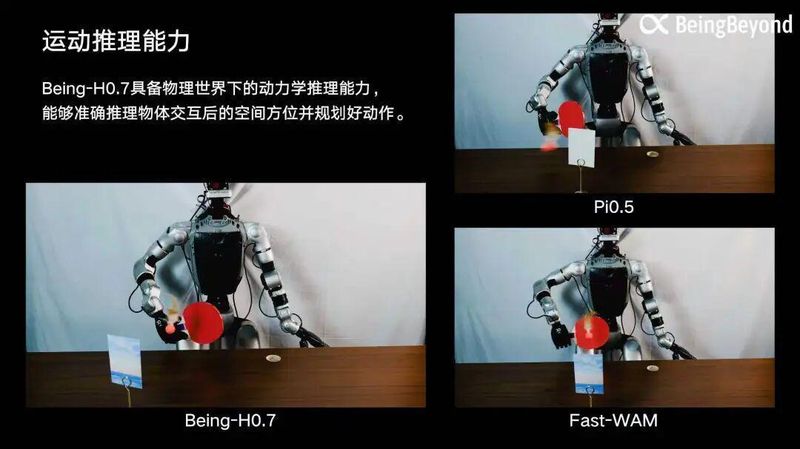

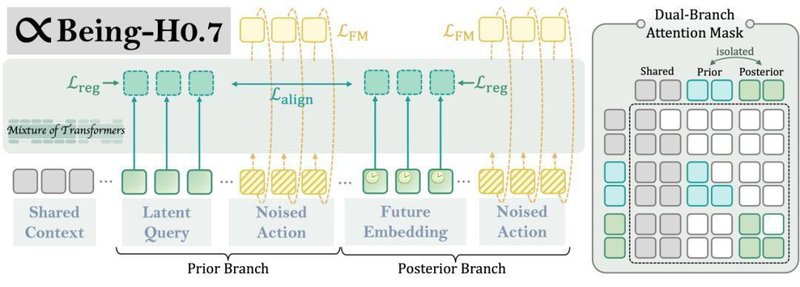

团队没有选择视频生成式路线。取而代之的是隐空间推理——将观察、任务目标、未来状态压缩到模型内部的中间表示,直接指导动作生成。

这种方法模拟的是人类的物理直觉。乒乓球运动员不会先在脑中生成下一秒的完整画面再决定挥拍,靠的是长期经验积累的快速判断。

H0.7正是让模型学到这种“潜意识”。

20万小时的人类视频预训练提供了行为先验。超过6项榜单综合排名全球第一印证了技术竞争力。

端侧部署:把世界模型压进芯片

关键突破发生在部署环节。

H0.7将世界模型的信息压缩了至少百倍,首次实现端侧硬件实时运行。在OrinNX平台(约75TOPS)上,世界模型不再需要云端算力支撑。

这意味着什么?具身智能的商业化路径不再受制于算力成本。

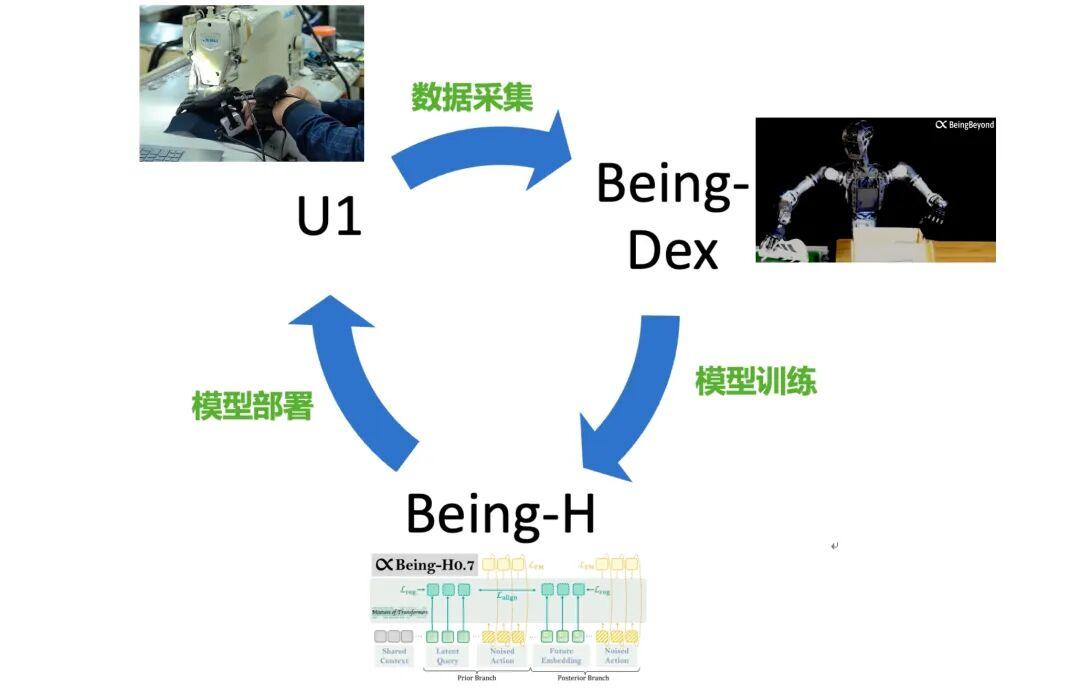

技术闭环:从数据到部署的全链路

仅有模型不够。团队同步搭建了闭环体系:Being-Dex负责场景快速适配,将新任务学习周期压缩至30分钟级;U1系统解决高质量数据持续获取问题。

三者的分工很清晰:模型层提供通用基座,适配层缩短落地周期,数据层保障真实场景的表达能力。

具身智能的三个关键要素——数据、模型、部署——第一次被打通。

范式转移的信号

H0.7的出现,本质上回答了一个问题:通用基座与专家能力如何共存?

答案在于“人类视频打底+场景专家专精”的双层架构。人类视频路线为泛化提供基础,U1系统弥合真实场景数据采集的最后缺口。

这种架构的价值不在于某个单点指标,而在于指明了一条可规模化的商业路径。

BeingBeyond的价值正在被看见:少数同时具备预训练、部署、数据采集全栈能力的公司之一。